Tecnologia Baseada em Visão do MIT Permite que Robôs Reconheçam e Entendam Seus Próprios Corpos

Créditos da imagem: MIT Csail

No Laboratório de Ciência da Computação e Inteligência Artificial (CSAIL) do MIT, uma mão robótica macia enrola lentamente os dedos em torno de um pequeno objeto. O que chama a atenção não é sua estrutura mecânica ou quaisquer sensores embutidos — porque ela não possui nenhum. Em vez disso, o sistema depende inteiramente de uma única câmera que observa as ações do robô e usa essa informação visual para guiar seus movimentos.

Essa capacidade vem de um novo sistema criado por pesquisadores do CSAIL, que oferece uma nova abordagem ao controle de robôs. Em vez de depender de modelos criados manualmente ou conjuntos complexos de sensores, o sistema permite que os robôs aprendam como seus corpos respondem a comandos usando apenas informações visuais. Conhecido como “Campos Jacobianos Neurais (NJF)”, o método fornece aos robôs uma forma de autoconsciência sobre sua forma física.

“Estamos deixando de programar robôs passo a passo para ensiná-los”, diz Sizhe Lester Li, doutorando no CSAIL do MIT e principal autor do estudo. “Atualmente, muitas tarefas robóticas exigem engenharia e codificação complexas. Nossa esperança é que, no futuro, possamos simplesmente mostrar uma tarefa a um robô e deixá-lo descobrir como fazê-la sozinho.”

Mudando o Foco do Hardware para o Controle por Meio de Modelos Autodidatas

A equipe percebeu que a principal barreira para uma robótica adaptável e de baixo custo não é o hardware, mas o controle. Tradicionalmente, os robôs são rígidos e repletos de sensores para permitir gêmeos digitais precisos para guiar os movimentos. Mas essas premissas se desfazem quando se lida com robôs macios, flexíveis ou de formato irregular. Em vez de adaptar máquinas a modelos, a NJF permite que eles aprendam com suas próprias observações.

Separar o processo de modelagem do projeto de hardware pode ampliar significativamente as possibilidades de inovação em robótica. Em robôs macios, os engenheiros frequentemente adicionam sensores ou reforços apenas para simplificar a modelagem e o controle. A NJF remove essa limitação. Sem sensores integrados ou ajustes de projeto, o sistema permite maior liberdade para explorar formas não convencionais de robôs sem preocupações com o controle.

“Pense em como você aprende a mover os dedos — você tenta movimentos diferentes, observa o que acontece e ajusta”, explica Li. “É exatamente assim que nosso sistema funciona. Ele testa ações aleatórias e aprende como cada uma afeta o corpo do robô.”

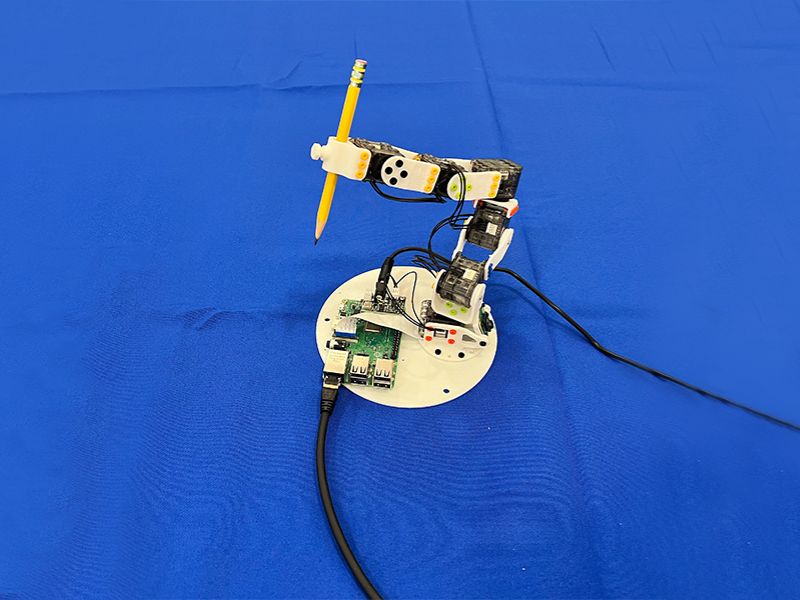

O método NJF apresentou resultados expressivos em diversos sistemas robóticos. Eles o testaram em uma mão macia, uma mão rígida Allegro, um braço impresso em 3D e uma plataforma rotativa sem sensores. Em todos os casos, o sistema aprendeu a estrutura e a resposta do robô usando apenas visão e tentativa e erro.

Expandindo o Potencial da NJF

Olhando para o futuro, os pesquisadores acreditam que o NJF tem aplicações muito além do laboratório. Robôs que utilizam este sistema podem realizar trabalhos agrícolas precisos, operar em canteiros de obras ou navegar em ambientes imprevisíveis sem sensores complexos.

O NJF utiliza uma rede neural para aprender a forma 3D de um robô e a resposta a sinais de controle. O sistema se baseia no NeRF, que reconstrói cenas 3D mapeando coordenadas para cor e densidade. O NJF expande isso aprendendo um campo Jacobiano, que prevê como pontos no robô se movem em resposta a comandos.

Para treinar o sistema, o robô executa ações aleatórias enquanto múltiplas câmeras capturam seus movimentos. O modelo não requer entrada manual ou conhecimento prévio — ele aprende os efeitos de controle por meio da observação.

Controle em Tempo Real com uma Única Câmera

Após o treinamento, o robô requer apenas uma única câmera monocular para controle em malha fechada em tempo real a aproximadamente 12 Hertz. Isso permite que o robô se observe continuamente, faça planos e responda em tempo real. Isso torna o NJF mais prático do que muitos métodos mais lentos, baseados em simulação, para robótica leve.

Nos testes iniciais, até mesmo dedos e controles deslizantes 2D básicos conseguiram aprender o mapeamento com apenas alguns exemplos. Ao modelar como certos pontos se movem ou se deformam em resposta a ações, o NJF constrói um mapa detalhado de controlabilidade. Esse modelo interno permite que o sistema generalize movimentos, mesmo com dados ruidosos ou incompletos.

“O fascinante é que o sistema aprende de forma autônoma quais motores influenciam quais partes do robô”, explica Li. “Não é pré-programado — essa compreensão surge por meio do aprendizado, semelhante a como uma pessoa descobre os controles de um novo dispositivo.”

O Futuro é Flexível

Por muitos anos, a robótica se concentrou em máquinas rígidas e facilmente previsíveis — como os braços robóticos industriais usados em fábricas — porque sua simplicidade os tornava mais fáceis de controlar. No entanto, o campo está cada vez mais se voltando para robôs flexíveis e bioinspirados, que podem interagir com o mundo real de forma mais natural. O desafio? Esses robôs são muito mais difíceis de modelar.

“A robótica atual muitas vezes parece inacessível devido a sensores caros e programação complexa”, afirma Vincent Sitzmann, autor sênior e professor assistente do MIT, que lidera o grupo de Representação de Cena. “Com os Campos Jacobianos Neurais, nosso objetivo é reduzir essas barreiras e tornar a robótica mais acessível, flexível e amplamente acessível. A visão atua como um sensor robusto e confiável que permite que robôs operem em ambientes caóticos e imprevisíveis — de fazendas a canteiros de obras — sem depender de infraestrutura dispendiosa.”

“A simples entrada visual permite o controle e a localização sem GPS ou sensores complexos”, afirma a coautora Daniela Rus. Isso permite um comportamento adaptativo em ambientes dinâmicos, desde drones sem mapas até robôs em ambientes desorganizados ou difíceis. Aprendendo com o feedback visual, o sistema constrói modelos internos para um controle flexível e autossupervisionado onde os métodos tradicionais falham.

Rumo a um Método de Treinamento Mais Acessível para Robôs por Telefone

Atualmente, o treinamento de NJF requer múltiplas câmeras e deve ser personalizado para cada robô. No entanto, os pesquisadores já estão vislumbrando uma versão mais amigável. No futuro, amadores poderão simplesmente gravar os movimentos espontâneos de um robô usando um smartphone — como documentar um carro alugado antes de dirigir — e usar esse vídeo para gerar um modelo de controle, sem a necessidade de qualquer conhecimento técnico ou ferramentas especializadas.

O sistema ainda não permite a transferência entre robôs e não possui sensor de toque, o que limita seu uso em tarefas que exigem muito contato. A equipe pretende superar esses limites aprimorando a generalização, lidando com oclusões e ampliando o raciocínio espaço-temporal.

“A NJF proporciona aos robôs uma espécie de autoconsciência incorporada — uma sensação intuitiva de como seus corpos se movem e respondem — usando apenas informações visuais”, afirma Li. É semelhante à forma como os humanos aprendem naturalmente a controlar seus membros. Esse tipo de compreensão é fundamental para permitir que os robôs realizem manipulações flexíveis em ambientes complexos. Em última análise, este trabalho marca uma mudança de modelos codificados manualmente para o aprendizado por meio da observação e da interação.

Um Esforço Colaborativo que Conecta Visão, Aprendizado e Robótica Suave

A pesquisa combina a expertise em visão computacional e aprendizado autossupervisionado do laboratório do pesquisador principal Vincent Sitzmann com os avanços em robótica suave do laboratório da diretora do CSAIL do MIT e professora da EECS, Daniela Rus. Os coautores do artigo incluem Sitzmann, Rus e Li, juntamente com os alunos de doutorado do CSAIL Annan Zhang SM ’22 e Boyuan Chen, a pesquisadora de graduação Hanna Matusik e o pós-doutorado Chao Liu.

O estudo recebeu financiamento do Fundo de Pesquisa Solomon Buchsbaum, por meio do Comitê de Apoio à Pesquisa do MIT, de uma Bolsa Presidencial do MIT, da Fundação Nacional de Ciências e do Instituto de Ciência e Tecnologia de Gwangju. As descobertas da equipe foram publicadas na Nature deste mês.

Leia o Artigo Original MIT Csail

Leia mais Pinwheel Lança um Smartwatch Infantil com um Chatbot com Tecnologia de IA