Créditos: singularityhub

Todos nós nos envolvemos em um diálogo interno — seja uma conversa estimulante ou uma reflexão silenciosa. Esses pensamentos não ditos muitas vezes revelam mais do que aquilo que dizemos em voz alta.

Agora, pesquisadores de Stanford desenvolveram um sistema de IA que decodifica a fala interna para ajudar pessoas com paralisia a se comunicarem — especialmente aquelas que têm dificuldades com as ferramentas atuais de conversão de cérebro para fala.

Ao contrário dos sistemas mais antigos que exigem a tentativa de fala, este decodificador traduz pensamentos silenciosos em fala com até 74% de precisão. Para proteger a privacidade, os usuários podem ativá-lo usando uma “senha neural” mental.

“Esta é a primeira vez que identificamos atividade cerebral ligada exclusivamente ao pensamento sobre a fala“, disse a autora do estudo, Erin Kunz. “Para aqueles com deficiências motoras e de fala graves, isso pode permitir uma comunicação mais fácil e natural.“

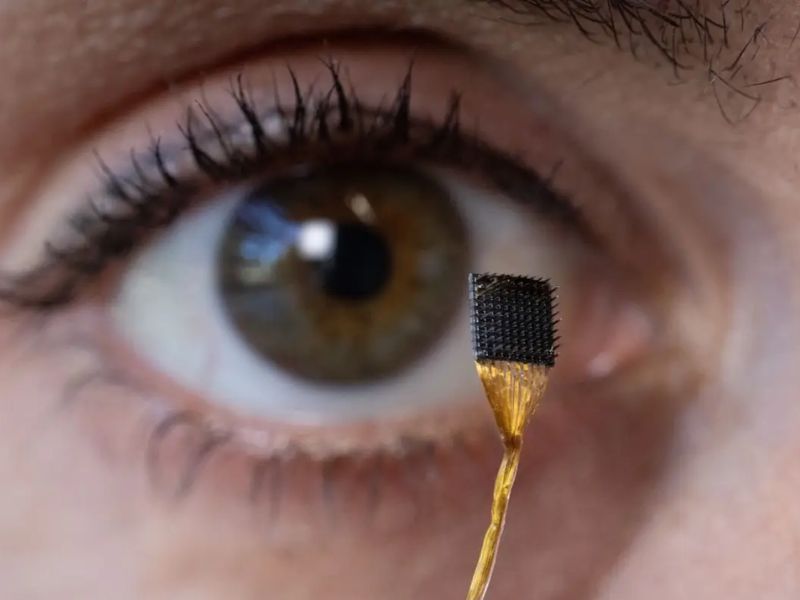

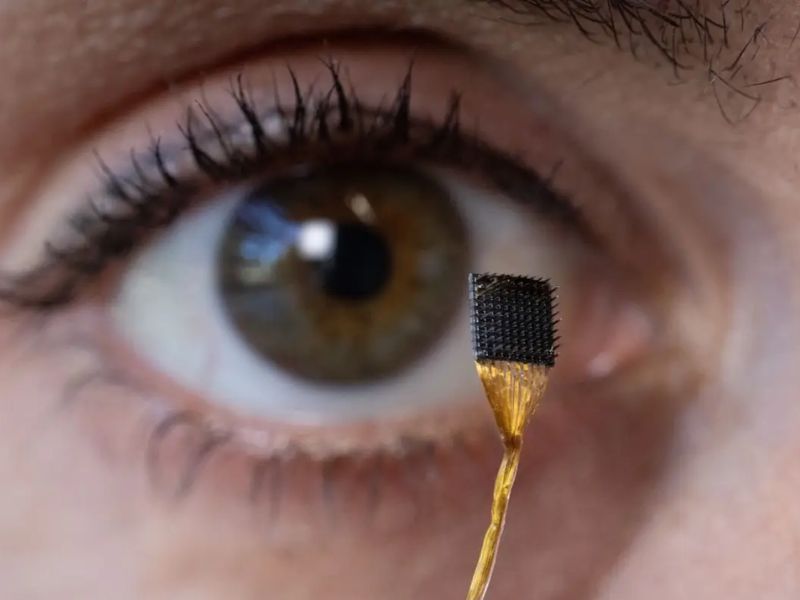

Como Implantes Cerebrais Transformam Pensamentos em Palavras

Normalmente, a fala começa com sinais cerebrais que controlam os músculos envolvidos na fala. Os implantes podem detectar esses sinais, permitindo que pessoas com paralisia se comuniquem novamente. Alguns sistemas recentes chegam a traduzir esses sinais em fala em tempo real. Por exemplo, um homem com ELA usou um implante de IA para converter sua atividade cerebral em frases claras. Os pensamentos de outro sobrevivente de derrame foram decodificados de forma semelhante em conversas em tempo real.

No entanto, esses sistemas ainda dependem da tentativa dos usuários de falar. Para pessoas incapazes de ativar os músculos vocais, pesquisadores estão desenvolvendo decodificadores que traduzem pensamentos internos puros em palavras.

Estudos anteriores descobriram que a fala interna ativa regiões cerebrais semelhantes — mas não idênticas — à linguagem falada. No entanto, identificar essas regiões tem sido difícil.

Para se aprofundar, a equipe de Stanford fez parceria com quatro participantes do estudo BrainGate2 com matrizes de microeletrodos implantadas. Uma delas, uma mulher de 68 anos com ELA, ainda conseguia vocalizar, mas não claramente. Outro, um homem de 33 anos com síndrome do encarceramento, conseguia apenas mover os olhos, mas era mentalmente aguçado.Como os Sinais Cerebrais Revelam Pensamentos Silenciosos

Para decodificar a fala interna, os pesquisadores registraram sinais elétricos do córtex motor dos participantes durante duas tarefas: tentar falar e pensar silenciosamente em palavras monossilábicas como “pipa” ou “dia“. Em alguns casos, os participantes também ouviram ou leram mentalmente as palavras. Ao analisar e comparar a atividade cerebral nesses diferentes cenários, a equipe conseguiu identificar as regiões específicas do córtex motor envolvidas na fala interna.

Com esses mapas cerebrais, eles treinaram um modelo de IA para interpretar os pensamentos internos dos participantes.

Equilibrando o Tamanho do Vocabulário e a Precisão da Decodificação

O sistema, embora promissor, não era perfeito. Mesmo com um vocabulário restrito de 50 palavras, a precisão da decodificação variou — as taxas de erro variaram de 14% a 33%, dependendo do indivíduo. Para dois participantes, a IA tentou decodificar frases usando um vocabulário muito maior, de 125.000 palavras, mas a precisão caiu ainda mais. Em um caso, uma frase como “Acho que tem o melhor sabor” foi traduzida erroneamente como “Acho que tem o melhor tocador“. Ainda assim, algumas frases — como “Não sei há quanto tempo você está aqui” — foram decodificadas corretamente.

Apesar de alguns erros, o autor do estudo, Benyamin Meschede-Krasa, observou que simplesmente pensar na fala — em vez de tentar falar — poderia tornar a comunicação mais rápida e fácil.

Os primeiros testes de fala interna foram estimulados, como se alguém dissesse “não pense em um elefante“. Para explorar a fala interna espontânea, a equipe pediu a um participante que jogasse um jogo de memória envolvendo setas e pistas visuais. O decodificador captou com sucesso a fala mental dela vinculada ao jogo.

Os pesquisadores também pediram aos participantes que pensassem em tópicos pessoais, como sua comida ou filme favorito. Embora o sistema tenha captado mais palavras do que durante os testes de mente em branco, a maioria dos resultados ainda era incoerente, com apenas frases claras ocasionais.

Em outras palavras, a IA não está lendo mentes — ainda.Salvaguardas para a Tecnologia de Decodificação de Pensamentos

À medida que a tecnologia avança, ela pode um dia detectar pensamentos não intencionais, levantando preocupações com a privacidade. Para lidar com isso, a equipe criou salvaguardas: uma distingue a fala interna das tentativas de fala (útil apenas se os usuários ainda puderem tentar falar) e outra usa uma “senha” mental para ativar a decodificação. Em um teste, o sistema detectou a senha com 99% de precisão.

À medida que as interfaces cérebro-computador evoluem, proteger a privacidade mental será crucial. O novo decodificador, que acessa diretamente a fala interna, pode reduzir o esforço do usuário e acelerar a comunicação — especialmente para aqueles com síndrome do encarceramento.

“O futuro das ICCs é promissor”, disse o autor do estudo, Frank Willett. “Este trabalho dá uma esperança real de que elas possam um dia permitir conversas fluentes e naturais.“