Ondas Cerebrais Transformadas em Palavras Faladas num Avanço da IA para a Paralisia

Investigadores da Universidade da Califórnia em Berkeley e da Universidade da Califórnia em São Francisco ligam o implante cerebral da sua paciente Ann ao computador sintetizador de voz. Noah Berger / UC Regents

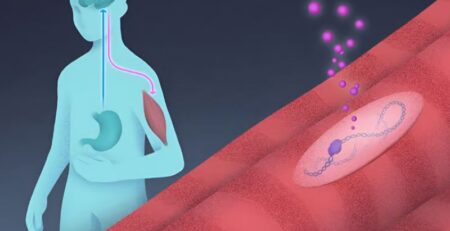

Investigadores da Califórnia criaram um sistema baseado em IA que permite a indivíduos paralisados falar naturalmente em tempo real, utilizando as suas próprias vozes.

A tecnologia inovadora desenvolvida por equipas da Universidade da Califórnia, em Berkeley, e da Universidade da Califórnia, em São Francisco, utiliza interfaces cérebro-computador que podem medir a atividade neural, combinadas com IA que aprende a replicar o som único da voz de um paciente.

Este avanço ultrapassa significativamente os anteriores desenvolvimentos em interfaces cérebro-computador para síntese da fala, que ainda estavam a dar os primeiros passos no ano passado.

Novo método de streaming permite uma fala natural

“O nosso método de streaming oferece as mesmas capacidades de descodificação rápida da fala encontradas em dispositivos como a Alexa e a Siri, mas aplicadas a neuropróteses”, disse Gopala Anumanchipalli, professor assistente de engenharia eléctrica e ciências da computação na UC Berkeley e co-investigador principal do estudo publicado esta semana na Nature Neuroscience. “Utilizando um algoritmo semelhante, descodificámos os dados neurais e, pela primeira vez, permitimos a transmissão de voz quase instantânea. Este avanço conduz a uma síntese de voz mais natural e fluente”.

O que torna esta tecnologia particularmente interessante é a sua capacidade de funcionar eficazmente com várias interfaces de deteção do cérebro. Estas incluem matrizes de eléctrodos de alta densidade que registam a atividade neural diretamente a partir da superfície do cérebro (como a configuração utilizada neste estudo), bem como microelectrodos que penetram no cérebro e sensores não invasivos de Eletromiografia de Superfície (sEMG) colocados no rosto para seguir os movimentos musculares.

O funcionamento é o seguinte: Primeiro, a neuroprótese recolhe dados neurais do córtex motor, a parte do cérebro que controla a produção da fala. De seguida, a IA descodifica estes dados em discurso. “O que estamos a descodificar acontece depois de um pensamento ser formado, depois de a pessoa decidir o que dizer, que palavras usar e como mover os seus músculos vocais”, explicou o coautor Cheol Jun Cho.

O sistema de IA foi treinado utilizando dados cerebrais captados enquanto os doentes tentavam falar silenciosamente palavras apresentadas num ecrã. Isto permitiu aos investigadores mapear a atividade cerebral associada a palavras específicas.

Utilização da voz do próprio doente para a saída de voz

Além disso, um modelo de conversão de texto em fala, desenvolvido com a voz do doente antes da lesão, gera o áudio que se ouve quando o doente “fala”.

Na demonstração da prova de conceito, o discurso resultante ainda não é perfeito nem tem um ritmo perfeito, mas está muito próximo. O sistema começa a descodificar os sinais cerebrais e a gerar discurso quase instantaneamente – num segundo – em comparação com 8 segundos num estudo anterior realizado em 2023.

Esta descoberta tem um enorme potencial para melhorar a qualidade de vida das pessoas com paralisia, ELA e doenças semelhantes, permitindo-lhes comunicar tudo, desde necessidades diárias a ideias complexas, e interagir com os seus entes queridos de uma forma mais natural.

Os próximos passos dos investigadores centrar-se-ão no aumento da velocidade de processamento da IA para gerar discurso ainda mais rápido e explorar formas de tornar a voz sintetizada mais expressiva.

Leia o Artigo Original: New Atlas

Leia mais: ChatGPT não é o único Chatbot que Atrai Mais Usuários

Deixe um comentário